Unterschied zwischen neuronalen Netzen und Deep Learning

Angesichts des enormen technologischen Wandels von heute sind mehr als nur Big Data und Hadoop erforderlich, um Unternehmen zu transformieren. Die Firmen von heute bewegen sich in Richtung KI und beziehen maschinelles Lernen als ihre neue Technik ein. Neuronale Netze oder verbindende Systeme sind die Systeme, die von unserem biologischen neuronalen Netz inspiriert sind. Diese Art von Systemen wird geschult, um sich an die Bedürfnisse anzupassen. Wenn sie beispielsweise bei der Bilderkennung mit Katzen identifiziert wurden, können sie diese Ergebnismenge problemlos verwenden, um Bilder von Katzen von Katzen ohne Katzen zu trennen. Dabei haben sie keine Vorkenntnisse über die Eigenschaften der Katze, sondern entwickeln ihre eigenen einzigartigen Merkmale, die bei ihrer Identifizierung hilfreich sind. Ein weiterer eng damit verbundener Begriff ist Deep Learning, auch hierarchisches Lernen genannt. Dies basiert auf dem Lernen von Datendarstellungen, die aufgabenbasierten Algorithmen entgegengesetzt sind. Es kann ferner in überwachte, halbüberwachte und unbeaufsichtigte Lerntechniken eingeteilt werden. Es gibt verschiedene mit Deep Learning verbundene Architekturen, wie beispielsweise tiefe neuronale Netze, Glaubensnetze und wiederkehrende Netze, deren Anwendung in der Verarbeitung natürlicher Sprache, der Bildverarbeitung, der Spracherkennung, der Filterung sozialer Netze, der Audioerkennung, der Bioinformatik, der maschinellen Übersetzung, dem Drogendesign und der Liste liegt geht immer weiter. Lassen Sie uns Neuronale Netze und Deep Learning in unserem Beitrag ausführlich besprechen.

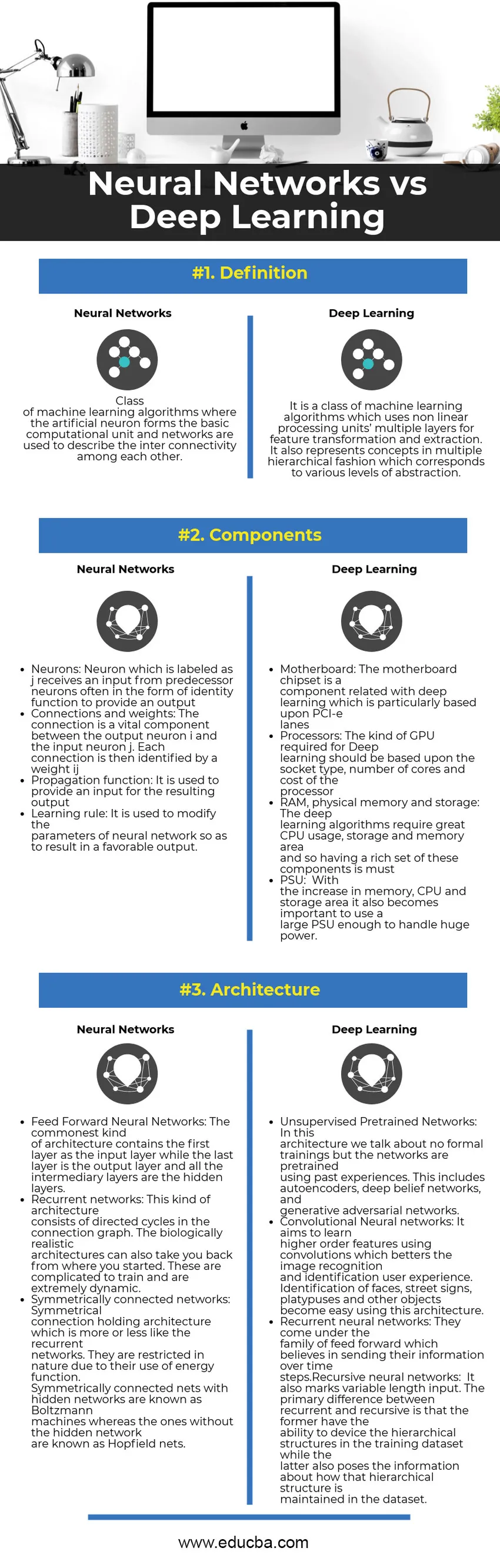

Head to Head Vergleich zwischen Neural Networks und Deep Learning (Infografik)

Hauptunterschiede zwischen neuronalen Netzen und Tiefenlernen:

Die Unterschiede zwischen neuronalen Netzen und Deep Learning werden in den folgenden Punkten erläutert:

- Neuronale Netze nutzen Neuronen, um Daten in Form von Ein- und Ausgabewerten zu übertragen. Sie werden verwendet, um Daten über Netzwerke oder Verbindungen zu übertragen. Deep Learning hingegen bezieht sich auf die Transformation und Extraktion von Merkmalen, mit denen versucht wird, eine Beziehung zwischen Reizen und damit verbundenen neuronalen Reaktionen im Gehirn herzustellen.

- Anwendungsgebiete für die neuronale Vernetzung umfassen Systemidentifikation, Management natürlicher Ressourcen, Prozesskontrolle, Fahrzeugkontrolle, Quantenchemie, Entscheidungsfindung, Spiel, Gesichtserkennung, Mustererkennung, Signalklassifikation, Sequenzerkennung, Objekterkennung, Finanzen, medizinische Diagnose, Visualisierung. Data Mining, maschinelle Übersetzung, E-Mail-Spam-Filterung, Filterung sozialer Netzwerke usw. Die Anwendung von Deep Learning umfasst die automatische Spracherkennung, Bilderkennung, Verarbeitung visueller Kunst, Verarbeitung natürlicher Sprache, Wirkstoffentdeckung und Toxikologie, Kundenbeziehungsmanagement, Empfehlungs-Engines, Mobil Werbung, Bioinformatik, Bildwiederherstellung etc.

- Zu den Kritikpunkten bei neuronalen Netzen zählen Trainingsprobleme, theoretische Probleme, Hardwareprobleme, praktische Gegenbeispiele zu Kritikpunkten und hybride Ansätze, während sie beim Deep Learning mit Theorie, Fehlern, Cyber-Bedrohung usw. zusammenhängen.

Vergleichstabelle zwischen Neuronalen Netzen und Deep Learning

| Vergleichsbasis | Neuronale Netze | Tiefes Lernen |

| Definition | Klasse von Algorithmen für maschinelles Lernen, bei denen das künstliche Neuron die grundlegende Recheneinheit bildet und Netzwerke verwendet werden, um die Interkonnektivität untereinander zu beschreiben | Hierbei handelt es sich um eine Klasse von Algorithmen für maschinelles Lernen, bei denen mehrere Ebenen nichtlinearer Verarbeitungseinheiten zur Merkmalsumwandlung und -extraktion verwendet werden. Es stellt auch Konzepte in mehreren hierarchischen Moden dar, die verschiedenen Abstraktionsebenen entsprechen. |

| Komponenten | Neuronen: Neuronen, die mit j bezeichnet sind, erhalten eine Eingabe von Vorgängerneuronen, häufig in Form einer Identitätsfunktion, um eine Ausgabe bereitzustellen. Verbindungen und Gewichte: Die Verbindung ist eine wichtige Komponente zwischen dem Ausgangsneuron i und dem Eingangsneuron j. Jede Verbindung wird dann durch ein Gewicht ij identifiziert. Ausbreitungsfunktion: Sie wird verwendet, um eine Eingabe für die resultierende Ausgabe bereitzustellen. Lernregel: Sie wird verwendet, um die Parameter des neuronalen Netzwerks zu ändern, um eine günstige Ausgabe zu erzielen. | Motherboard: Der Motherboard-Chipsatz ist eine Komponente im Zusammenhang mit Deep Learning, die insbesondere auf PCI-E-Lanes basiert. Prozessoren : Die Art der für Deep Learning erforderlichen GPU sollte vom Sockeltyp, der Anzahl der Kerne und den Kosten des Prozessors abhängen. RAM, physischer Speicher und Speicher: Die Deep-Learning-Algorithmen erfordern viel CPU-Auslastung, Speicher und Speicherbereich. Daher ist es ein Muss, über einen umfangreichen Satz dieser Komponenten zu verfügen. Netzteil: Mit der Zunahme von Arbeitsspeicher, CPU und Speicherplatz wird es auch wichtig, ein großes Netzteil zu verwenden, das für die Bewältigung einer enormen Leistung ausreicht. |

| Die Architektur | Neuronale Netze mit Vorwärtskopplung: Die gängigste Architektur enthält die erste Ebene als Eingabeebene, während die letzte Ebene die Ausgabeebene und alle Zwischenebenen die verborgenen Ebenen sind. Wiederkehrende Netzwerke: Diese Art von Architektur besteht aus gerichteten Zyklen im Verbindungsgraphen. Die biologisch realistischen Architekturen können Sie auch dorthin zurückbringen, wo Sie begonnen haben. Diese sind kompliziert zu trainieren und äußerst dynamisch. Symmetrisch verbundene Netzwerke: Symmetrische Architektur zum Halten von Verbindungen, die mehr oder weniger den wiederkehrenden Netzwerken ähnelt. Sie sind aufgrund ihrer energetischen Funktion von Natur aus eingeschränkt. Symmetrisch verbundene Netze mit versteckten Netzwerken werden als Boltzmann-Maschinen bezeichnet, während die Netze ohne verstecktes Netzwerk als Hopfield-Netze bezeichnet werden. | Unbeaufsichtigte vorgeübte Netzwerke: In dieser Architektur wird von keiner formalen Schulung gesprochen, die Netzwerke werden jedoch anhand vergangener Erfahrungen vorgeübt. Dies umfasst Autoencoder, Deep-Believe-Netzwerke und generative gegnerische Netzwerke. Faltungs-Neuronale Netze: Ziel ist es, mithilfe von Faltungen Merkmale höherer Ordnung zu lernen, die die Benutzererfahrung bei der Bilderkennung und -identifizierung verbessern. Die Identifizierung von Gesichtern, Straßenschildern, Schnabeltieren und anderen Objekten wird mit dieser Architektur einfach. Wiederkehrende neuronale Netze: Sie stammen aus der Familie der Feedforwards, die daran glauben, ihre Informationen über Zeitschritte hinweg zu senden. Rekursive neuronale Netze: Markiert auch Eingaben mit variabler Länge. Der Hauptunterschied zwischen rekursiv und wiederkehrend besteht darin, dass erstere die hierarchischen Strukturen im Trainingsdatensatz festhalten können, während letztere auch die Informationen darüber bereitstellen, wie diese hierarchische Struktur im Datensatz beibehalten wird. |

Fazit - Neuronale Netze vs. Deep Learning

KI ist ein äußerst mächtiges und interessantes Gebiet, das in Zukunft allgegenwärtiger und wichtiger wird und mit Sicherheit enorme Auswirkungen auf die Gesellschaft insgesamt haben wird. Diese beiden Techniken sind einige der mächtigsten Werkzeuge von AI zur Lösung komplexer Probleme und werden in Zukunft weiterentwickelt und ausgebaut, damit wir sie nutzen können.

Empfohlener Artikel

Dies war ein Leitfaden für neuronale Netze im Vergleich zu Deep Learning, deren Bedeutung, Kopf-an-Kopf-Vergleich, Hauptunterschiede, Vergleichstabelle und Schlussfolgerung. Sie können sich auch die folgenden Artikel ansehen, um mehr zu erfahren -

- Best 7 Unterschied zwischen Data Mining und Datenanalyse

- Maschinelles Lernen vs Predictive Analytics - 7 nützliche Unterschiede

- Data Mining Vs Data Visualization - Welches ist besser

- Business Intelligence vs BigData - 6 erstaunliche Vergleiche