Einführung in den K-Means-Clustering-Algorithmus?

K-Means Clustering gehört zum unbeaufsichtigten Lernalgorithmus. Es wird verwendet, wenn die Daten nicht in Gruppen oder Kategorien definiert sind, dh nicht beschriftete Daten. Ziel dieses Clustering-Algorithmus ist es, die Gruppen in den Daten zu suchen und zu finden, wobei die Variable K die Anzahl der Gruppen darstellt.

K-Means Clustering Algorithmus verstehen

Dieser Algorithmus ist ein iterativer Algorithmus, der den Datensatz gemäß seinen Merkmalen in K vordefinierte nicht überlappende unterschiedliche Cluster oder Untergruppen unterteilt. Dadurch werden die Datenpunkte zwischen Clustern so ähnlich wie möglich und es wird auch versucht, die Cluster so weit wie möglich zu halten. Es ordnet die Datenpunkte einem Cluster zu, wenn die Summe der quadratischen Distanz zwischen dem Clusterschwerpunkt und den Datenpunkten ein Minimum aufweist, wobei der Clusterschwerpunkt das arithmetische Mittel der Datenpunkte im Cluster ist. Eine geringere Variation im Cluster führt zu ähnlichen oder homogenen Datenpunkten im Cluster.

Wie funktioniert der K-Means-Clustering-Algorithmus?

Der K-Means-Clustering-Algorithmus benötigt die folgenden Eingaben:

- K = Anzahl der Untergruppen oder Cluster

- Probe- oder Trainingsset = (x 1, x 2, x 3, ……… x n )

Nehmen wir nun an, wir haben einen Datensatz, der nicht beschriftet ist, und wir müssen ihn in Cluster aufteilen.

Nun müssen wir die Anzahl der Cluster ermitteln. Dies kann auf zwei Arten geschehen:

- Ellenbogen-Methode.

- Zweck Methode.

Lassen Sie uns sie kurz besprechen:

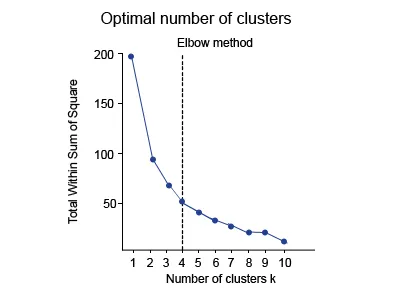

Ellenbogen-Methode

Bei dieser Methode wird eine Kurve zwischen „innerhalb der Quadratsumme“ (WSS) und der Anzahl der Cluster gezeichnet. Die eingezeichnete Kurve ähnelt einem menschlichen Arm. Es wird die Ellbogenmethode genannt, da der Punkt des Ellbogens in der Kurve die optimale Anzahl von Clustern ergibt. In der Grafik oder Kurve ändert sich der Wert von WSS nach dem Ellbogenpunkt sehr langsam, sodass der Ellbogenpunkt berücksichtigt werden muss, um den endgültigen Wert für die Anzahl der Cluster zu erhalten.

Zweckgebunden

Bei dieser Methode werden die Daten basierend auf verschiedenen Metriken geteilt und danach wird beurteilt, wie gut sie für diesen Fall ausgeführt wurden. Beispielsweise erfolgt die Anordnung der Hemden in der Herrenbekleidungsabteilung in einem Einkaufszentrum nach den Kriterien der Größen. Es kann auch auf der Grundlage des Preises und der Marken erfolgen. Das am besten geeignete würde ausgewählt, um die optimale Anzahl von Clustern zu ergeben, dh den Wert von K.

Kommen wir nun zu unserem oben angegebenen Datensatz zurück. Wir können die Anzahl der Cluster, dh den Wert von K, mit einer der oben genannten Methoden berechnen.

Wie verwende ich die oben genannten Methoden?

Nun sehen wir uns den Ausführungsprozess an:

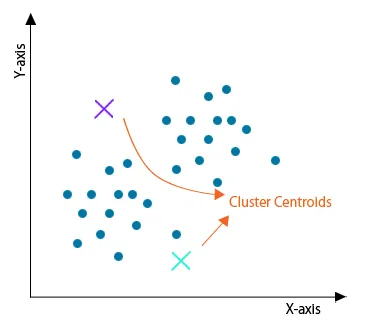

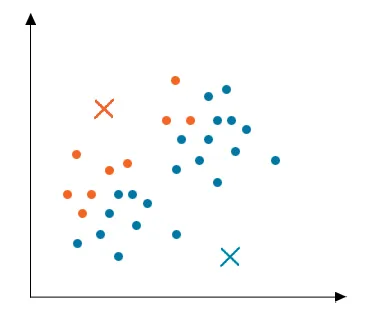

Schritt 1: Initialisierung

Initialisieren Sie zunächst alle zufälligen Punkte, die als die Schwerpunkte des Clusters bezeichnet werden. Während der Initialisierung müssen Sie darauf achten, dass die Schwerpunkte des Clusters kleiner sind als die Anzahl der Trainingsdatenpunkte. Dieser Algorithmus ist ein iterativer Algorithmus, daher werden die nächsten beiden Schritte iterativ ausgeführt.

Schritt 2: Clusterzuweisung

Nach der Initialisierung werden alle Datenpunkte durchlaufen und der Abstand zwischen allen Schwerpunkten und den Datenpunkten berechnet. Nun würden sich die Cluster in Abhängigkeit vom Mindestabstand zu den Schwerpunkten bilden. In diesem Beispiel werden die Daten in zwei Cluster aufgeteilt.

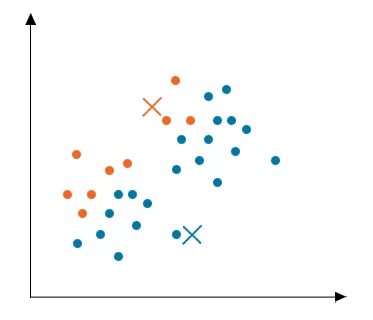

Schritt 3: Verschieben von Centroid

Da die im obigen Schritt gebildeten Cluster nicht optimiert sind, müssen optimierte Cluster gebildet werden. Dazu müssen wir die Schwerpunkte iterativ an einen neuen Ort verschieben. Nehmen Sie Datenpunkte eines Clusters, berechnen Sie deren Durchschnitt und verschieben Sie dann den Schwerpunkt dieses Clusters an diese neue Position. Wiederholen Sie diesen Schritt für alle anderen Cluster.

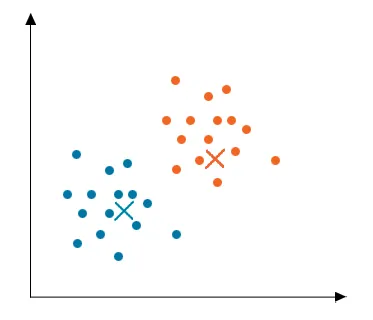

Schritt 4: Optimierung

Die beiden obigen Schritte werden iterativ ausgeführt, bis die Zentroide stehen bleiben, dh, sie ändern ihre Position nicht mehr und sind statisch geworden. Sobald dies erledigt ist, wird der k-means-Algorithmus als konvergiert bezeichnet.

Schritt 5: Konvergenz

Jetzt ist dieser Algorithmus konvergiert und es werden eindeutige Cluster gebildet und deutlich sichtbar. Dieser Algorithmus kann abhängig davon, wie die Cluster im ersten Schritt initialisiert wurden, unterschiedliche Ergebnisse liefern.

Anwendungen des K-Means-Clustering-Algorithmus

- Marktsegmentierung

- Dokument-Clustering

- Bildsegmentierung

- Bildkompression

- Vektorquantisierung

- Clusteranalyse

- Feature-Learning oder Wörterbuchlernen

- Ermittlung kriminalitätsgefährdeter Gebiete

- Aufdeckung von Versicherungsbetrug

- ÖPNV-Datenanalyse

- Clustering von IT-Assets

- Kundensegmentierung

- Krebsdaten identifizieren

- Wird in Suchmaschinen verwendet

- Vorhersage der Arzneimittelaktivität

Vorteile des K-Means-Clustering-Algorithmus

- Es ist schnell

- Robust

- Einfach zu verstehen

- Vergleichsweise effizient

- Wenn Datensätze unterschiedlich sind, werden die besten Ergebnisse erzielt

- Produzieren Sie engere Cluster

- Wenn Schwerpunkte neu berechnet werden, ändert sich der Cluster.

- Flexibel

- Einfach zu interpretieren

- Bessere Rechenkosten

- Verbessert die Genauigkeit

- Funktioniert besser mit sphärischen Clustern

Nachteile des K-Means-Clustering-Algorithmus

- Benötigt eine vorherige Spezifikation für die Anzahl der Cluster-Zentren

- Wenn es zwei sich stark überlappende Daten gibt, können sie nicht unterschieden werden und können nicht sagen, dass es zwei Cluster gibt

- Mit der unterschiedlichen Darstellung der Daten sind auch die erzielten Ergebnisse unterschiedlich

- Der euklidische Abstand kann die Faktoren ungleich gewichten

- Es gibt das lokale Optimum der quadratischen Fehlerfunktion an

- Manchmal kann die zufällige Auswahl der Zentroide keine fruchtbaren Ergebnisse bringen

- Kann nur verwendet werden, wenn die Bedeutung definiert ist

- Kann nicht mit Ausreißern und verrauschten Daten umgehen

- Arbeiten Sie nicht mit dem nichtlinearen Datensatz

- Fehlt die Konsistenz

- Empfindlich im Maßstab

- Wenn sehr große Datenmengen gefunden werden, kann der Computer abstürzen.

- Vorhersageprobleme

Empfohlene Artikel

Dies war eine Anleitung zum K-Means-Clustering-Algorithmus. Hier diskutierten wir die Arbeitsweise, Anwendungen, Vor- und Nachteile des K-Means-Clustering-Algorithmus. Sie können auch unsere anderen Artikelvorschläge durchgehen, um mehr zu erfahren -

- Was sind neuronale Netze?

- Was ist Data Mining? | Rolle von Data Mining

- Data Mining Interview Frage

- Maschinelles Lernen vs Neuronales Netz

- Clustering im maschinellen Lernen