Was ist Big Data-Technologie?

Wie wir wissen, entwickeln sich Daten ständig weiter. Das Wachstum der Daten hat den menschlichen Verstand herausgefordert, diese zu extrahieren, zu analysieren und damit umzugehen. Dies ist darauf zurückzuführen, dass herkömmliche Methoden zum Umgang mit Daten diese großen Datenmengen nicht unterstützen. Big Data wird in der Regel durch drei Konzepte beschrieben: Volumen, Vielfalt und Geschwindigkeit.

Daten sind mittlerweile das wichtigste Kapital eines jeden Unternehmens. Die Analyse dieser Big Data hilft dem Unternehmen dabei, das Verhalten seiner Kunden zu analysieren und relevante Dinge im Zusammenhang mit datengesteuerten Entscheidungen vorherzusagen. Auf diese Weise kann das Unternehmen selbstbewusster vorgehen und stärkere Strategien entwickeln.

In Anbetracht des Tempos, mit dem Daten in der heutigen Zeit zunehmen, wird Big Data in naher Zukunft ein riesiges Arbeitsfeld sein. Alle Studenten, Studienanfänger und Profis müssen auf dem neuesten Stand der aufkommenden Big-Data-Technologien sein. Sich auf dem Laufenden zu halten, bringt eine großartige und erfolgreiche Karriere auf dem beruflichen Weg.

Big Data-Technologien

Hier liste ich einige Big-Data-Technologien mit einer klaren Erklärung auf, um Sie auf die kommenden Trends und Technologien aufmerksam zu machen:

-

Apache Spark:

Es ist eine schnelle Big-Data-Verarbeitungs-Engine. Dabei wird die Echtzeitverarbeitung für Daten berücksichtigt. Die umfangreiche Bibliothek für maschinelles Lernen eignet sich gut für die Arbeit in KI und ML. Es verarbeitet Daten parallel und auf Clustercomputern. Der von Spark verwendete Basisdatentyp ist RDD (Resilient Distributed Data Set).

-

NoSQL-Datenbanken:

Es sind nicht relationale Datenbanken, die ein schnelles Speichern und Abrufen von Daten ermöglichen. Seine Fähigkeit, mit allen Arten von Daten wie strukturierten, halbstrukturierten, unstrukturierten und polymorphen Daten umzugehen, ist einzigartig. Es gibt keine SQL-Datenbanken der folgenden Typen:

- Dokumentdatenbanken : Sie speichern Daten in Form von Dokumenten, die viele verschiedene Schlüssel-Wert-Paare enthalten können.

- Grafikspeicher : Hier werden Daten gespeichert, die normalerweise in Form eines Netzwerks gespeichert werden, z. B. Social Media-Daten.

- Schlüsselwertspeicher : Dies sind die einfachsten NoSQL-Datenbanken. Jedes einzelne Element in der Datenbank wird zusammen mit seinem Wert als Attributname (oder "Schlüssel") gespeichert.

- Breitspaltenspeicher : In dieser Datenbank werden Daten im Spaltenformat und nicht im zeilenbasierten Format gespeichert. Cassandra und HBase sind gute Beispiele dafür.

-

Apache Kafka:

Kafka ist eine verteilte Event-Streaming-Plattform, die täglich eine Vielzahl von Events abwickelt. Da es schnell und skalierbar ist, ist es hilfreich, Echtzeit-Streaming-Daten-Pipelines zu erstellen, die zuverlässig Daten zwischen Systemen oder Anwendungen abrufen.

-

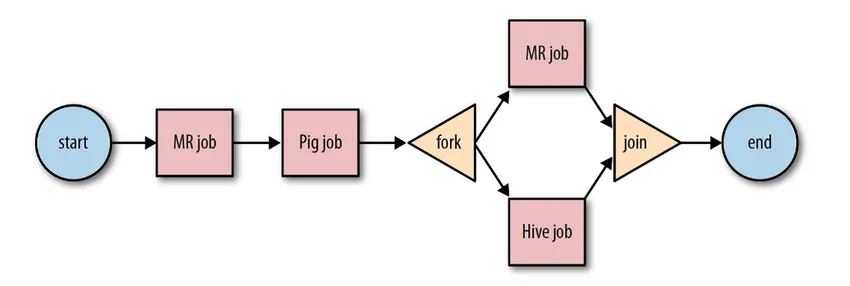

Apache Oozie:

Es ist ein Workflow-Scheduler-System zur Verwaltung von Hadoop-Jobs. Diese Workflow-Jobs werden in Form von gerichteten azyklischen Diagrammen (Directed Acyclical Graphs, DAGs) für Aktionen geplant.

Quelle: Google

Die skalierbare und organisierte Lösung für Big-Data-Aktivitäten.

-

Apache Airflow:

Dies ist eine Plattform, die den Workflow plant und überwacht. Smart Scheduling hilft bei der Organisation und effizienten Ausführung des Projekts. Airflow kann eine DAG-Instanz erneut ausführen, wenn ein Fehler auftritt. Die umfangreiche Benutzeroberfläche erleichtert die Visualisierung von Pipelines, die in verschiedenen Phasen wie der Produktion ausgeführt werden, überwacht den Fortschritt und behebt bei Bedarf Probleme.

-

Apache Beam:

Es ist ein einheitliches Modell zum Definieren und Ausführen von Datenverarbeitungs-Pipelines, die ETL und kontinuierliches Streaming umfassen. Das Apache Beam-Framework bietet eine Abstraktion zwischen Ihrer Anwendungslogik und dem Big Data-Ökosystem, da es keine API gibt, die alle Frameworks wie Hadoop, Spark usw. bindet.

-

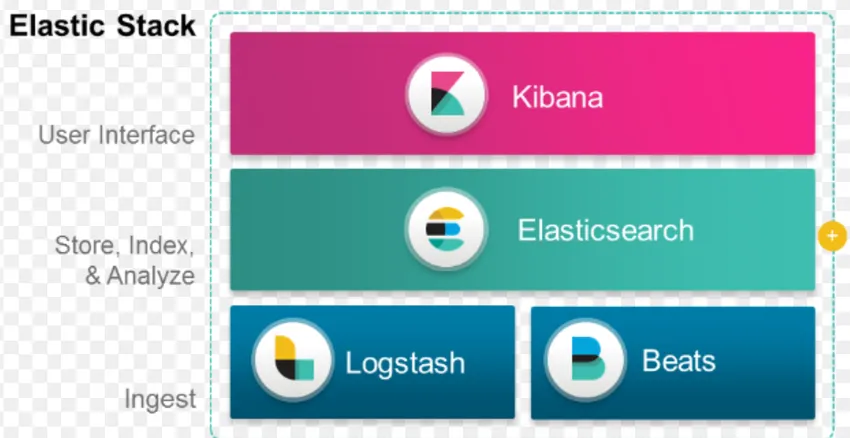

ELK Stack:

ELK ist bekannt für Elasticsearch, Logstash und Kibana.

Elasticsearch ist eine Datenbank ohne Schema (die jedes einzelne Feld indiziert), die leistungsstarke Suchfunktionen bietet und einfach skalierbar ist.

Logstash ist ein ETL-Tool, mit dem wir Ereignisse in Elasticsearch abrufen, transformieren und speichern können.

Kibana ist ein Dashboarding-Tool für Elasticsearch, mit dem Sie alle gespeicherten Daten analysieren können. Die aus Kibana gewonnenen umsetzbaren Erkenntnisse helfen beim Aufbau von Strategien für eine Organisation. Von der Erfassung von Änderungen bis zur Vorhersage hat sich Kibana immer als sehr nützlich erwiesen.

-

Docker & Kubernete:

Dies sind die neuen Technologien, mit denen Anwendungen in Linux-Containern ausgeführt werden können. Docker ist eine Open-Source-Sammlung von Tools, mit deren Hilfe Sie beliebige Apps erstellen, versenden und ausführen können.

Kubernetes ist auch eine Open-Source-Container- / Orchestrierungsplattform, mit der eine große Anzahl von Containern harmonisch zusammenarbeiten kann. Dies reduziert letztendlich die Betriebsbelastung.

-

TensorFlow:

Es ist eine Open-Source-Bibliothek für maschinelles Lernen, die zum Entwerfen, Erstellen und Trainieren von Deep-Learning-Modellen verwendet wird. Alle Berechnungen werden in TensorFlow mit Datenflussdiagrammen durchgeführt. Graphen bestehen aus Knoten und Kanten. Knoten stellen mathematische Operationen dar, während die Kanten die Daten darstellen.

TensorFlow ist hilfreich für Forschung und Produktion. Es wurde unter Berücksichtigung dessen entwickelt, dass es auf mehreren CPUs oder GPUs und sogar auf mobilen Betriebssystemen ausgeführt werden kann. Dies könnte in Python, C ++, R und Java implementiert werden.

-

Presto:

Presto ist eine von Facebook entwickelte Open-Source-SQL-Engine, die Petabytes an Daten verarbeiten kann. Im Gegensatz zu Hive ist Presto nicht von der MapReduce-Technik abhängig und kann die Daten daher schneller abrufen. Seine Architektur und Oberfläche sind einfach genug, um mit anderen Dateisystemen zu interagieren.

Aufgrund der geringen Latenz und der einfachen interaktiven Abfrage ist es heutzutage sehr beliebt, große Datenmengen zu verarbeiten.

-

Polybase:

Polybase verwendet SQL Server, um auf Daten zuzugreifen, die in PDW (Parallel Data Warehouse) gespeichert sind. PDW wurde für die Verarbeitung beliebiger relationaler Datenmengen entwickelt und ermöglicht die Integration in Hadoop.

-

Bienenstock:

Hive ist eine Plattform für Datenabfragen und Datenanalysen über große Datenmengen. Es stellt eine SQL-ähnliche Abfragesprache namens HiveQL bereit, die intern in MapReduce konvertiert und anschließend verarbeitet wird.

Mit dem schnellen Wachstum der Daten und dem großen Bestreben des Unternehmens, Big Data zu analysieren, hat die Technologie so viele ausgereifte Technologien auf den Markt gebracht, dass es von großem Vorteil ist, sie zu kennen. Heutzutage begegnet die Big Data-Technologie vielen geschäftlichen Anforderungen und Problemen, indem sie die betriebliche Effizienz erhöht und das relevante Verhalten vorhersagt. Eine Karriere im Bereich Big Data und der damit verbundenen Technologie kann sowohl für den Einzelnen als auch für Unternehmen viele Möglichkeiten eröffnen.

Fortan ist es höchste Zeit, Big-Data-Technologien einzuführen.

Empfohlene Artikel

Dies war ein Leitfaden für What is Big Data Technology. Hier haben wir einige Big-Data-Technologien wie Hive, Apache Kafka, Apache Beam, ELK Stack usw. besprochen. Sie können auch den folgenden Artikel lesen, um mehr zu erfahren.

- Was ist tiefes Lernen?

- Anleitung zu Minitab?

- Was ist Salesforce-Technologie?

- Was ist Big Data Analytics?