Einführung in die Rückwärtseliminierung

Während Mensch und Maschine auf die digitale Evolution zusteuern, müssen sich verschiedene technische Maschinen nicht nur trainieren, sondern auch schlau trainieren, um Objekte der realen Welt besser erkennen zu können. Eine solche früher eingeführte Technik, die als "Rückwärtseliminierung" bezeichnet wurde, sollte unverzichtbare Merkmale begünstigen und gleichzeitig nugatorische Merkmale beseitigen, um eine bessere Optimierung in einer Maschine zu erreichen. Die gesamte Kompetenz der maschinellen Objekterkennung hängt von den jeweiligen Merkmalen ab.

Merkmale, die keinen Bezug zur prognostizierten Leistung haben, müssen aus der Maschine ausgeschleust werden und werden durch Rückwärtsbeseitigung geschlossen. Gute Präzision und zeitliche Komplexität der Erkennung eines realen Wortobjekts durch die Maschine hängen vom Lernen ab. Das Rückwärts-Eliminieren spielt also seine starre Rolle bei der Merkmalsauswahl. Es berechnet die Abhängigkeitsrate von Merkmalen von der abhängigen Variablen und ermittelt die Bedeutung ihrer Zugehörigkeit zum Modell. Um dies zu bestätigen, überprüft es die berechnete Rate mit einem Standard-Signifikanzniveau (beispielsweise 0, 06) und trifft eine Entscheidung für die Merkmalsauswahl.

Warum führen wir eine Rückwärtseliminierung durch ?

Unnötige und redundante Merkmale beschleunigen die Komplexität der Maschinenlogik. Es verschlingt unnötig Zeit und Ressourcen des Modells. Die vorgenannte Technik spielt also eine kompetente Rolle, um das Modell einfach zu schmieden. Der Algorithmus kultiviert die beste Version des Modells, indem er die Leistung optimiert und die verbrauchbaren festgelegten Ressourcen abschneidet.

Es reduziert die am wenigsten bemerkenswerten Merkmale des Modells, die bei der Bestimmung der Regressionslinie Rauschen verursachen. Irrelevante Objektmerkmale können zu Fehlklassifizierungen und Vorhersagen führen. Irrelevante Merkmale eines Unternehmens können ein Ungleichgewicht im Modell in Bezug auf andere signifikante Merkmale anderer Objekte darstellen. Die Beseitigung nach hinten fördert die Anpassung des Modells an den besten Fall. Daher wird empfohlen, die Rückwärtseliminierung in einem Modell zu verwenden.

Wie wende ich die Rückwärtseliminierung an?

Die Rückwärtseliminierung beginnt mit allen Merkmalsvariablen und testet sie mit der abhängigen Variablen unter einer ausgewählten Anpassung des Modellkriteriums. Es beginnt, jene Variablen zu beseitigen, die die passende Regressionslinie verschlechtern. Wiederholen Sie diesen Vorgang, bis das Modell eine gute Anpassung erreicht hat. Im Folgenden sind die Schritte zum Üben der Rückwärtseliminierung aufgeführt:

Schritt 1: Wählen Sie das entsprechende Signifikanzniveau aus, das im Modell der Maschine enthalten sein soll. (Nehmen Sie S = 0, 06)

Schritt 2: Geben Sie alle verfügbaren unabhängigen Variablen in Bezug auf die abhängige Variable an das Modell und berechnen Sie die Steigung und den Achsenabschnitt, um eine Regressions- oder Anpassungslinie zu zeichnen.

Schritt 3: Durchlaufen Sie nacheinander alle unabhängigen Variablen mit dem höchsten Wert (Take I) und fahren Sie mit folgendem Toast fort:

a) Wenn I> S, führen Sie den 4. Schritt aus.

b) Andernfalls wird abgebrochen und das Modell ist perfekt.

Schritt 4: Entfernen Sie die ausgewählte Variable und erhöhen Sie den Durchlauf.

Schritt 5: Schmieden Sie das Modell erneut und berechnen Sie die Steigung und den Schnittpunkt der Anpassungslinie erneut mit Restvariablen.

Die oben genannten Schritte werden in der Zurückweisung derjenigen Merkmale zusammengefasst, deren Signifikanzrate über dem ausgewählten Signifikanzwert (0, 06) liegt, um einer Überklassifizierung und Überauslastung von Ressourcen zu entgehen, die als hochkomplex angesehen werden.

Vor- und Nachteile der Rückwärtseliminierung

Nachfolgend einige Vor- und Nachteile der Rückwärtseliminierung:

1. Verdienste

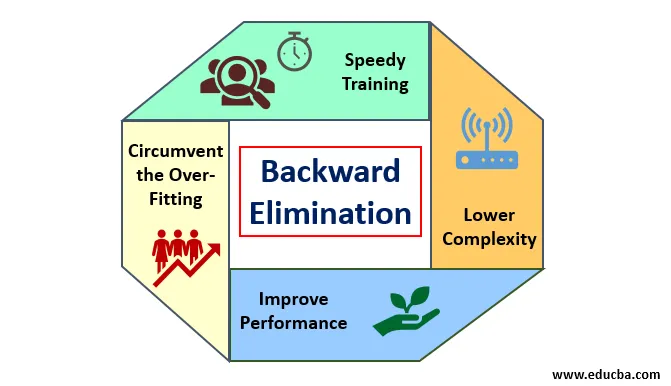

Die Vorzüge der Rückwärtseliminierung sind wie folgt:

- Schnelles Training: Die Maschine wird mit einer Reihe verfügbarer Mustermerkmale trainiert, die in sehr kurzer Zeit ausgeführt werden, wenn nicht benötigte Merkmale aus dem Modell entfernt werden. Ein schnelles Trainieren des Datensatzes ist nur dann möglich, wenn das Modell wichtige Funktionen ausführt und alle Rauschvariablen ausschließt. Es zeichnet sich eine einfache Komplexität für das Training aus. Das Modell sollte jedoch keiner Unteranpassung unterzogen werden, die auf fehlende Merkmale oder unzureichende Stichproben zurückzuführen ist. Das Beispiel-Feature sollte in einem Modell für die beste Klassifizierung reichlich vorhanden sein. Die zum Trainieren des Modells erforderliche Zeit sollte unter Beibehaltung der Klassifizierungsgenauigkeit kürzer sein und keine unter der Vorhersage liegende Variable aufweisen.

- Geringere Komplexität: Die Komplexität des Modells ist hoch, wenn das Modell das Ausmaß der Features einschließlich Rauschen und nicht verwandter Features berücksichtigt. Das Modell benötigt viel Platz und Zeit, um eine solche Bandbreite von Features zu verarbeiten. Dies kann die Genauigkeitsrate der Mustererkennung erhöhen, die Rate kann jedoch auch Rauschen enthalten. Um eine derart hohe Komplexität des Modells zu vermeiden, spielt der Rückwärtseliminierungsalgorithmus eine erforderliche Rolle, indem die unerwünschten Merkmale aus dem Modell entfernt werden. Dies vereinfacht die Verarbeitungslogik des Modells. Nur ein paar wesentliche Merkmale sind ausreichend, um eine gute Passform zu zeichnen, die mit einer angemessenen Genauigkeit zufrieden ist.

- Leistung verbessern: Die Modellleistung hängt von vielen Aspekten ab. Das Modell wird mithilfe der Rückwärtseliminierung optimiert. Die Optimierung des Modells ist die Optimierung des Datensatzes, der zum Trainieren des Modells verwendet wird. Die Leistung des Modells ist direkt proportional zu seiner Optimierungsrate, die von der Häufigkeit signifikanter Daten abhängt. Der Rückwärts-Eliminierungsprozess soll keine Änderung von einem Niederfrequenz-Prädikator starten. Es beginnt jedoch erst mit der Änderung von Hochfrequenzdaten, da die Komplexität des Modells hauptsächlich von diesem Teil abhängt.

- Umgehen der Überanpassung : Die Überanpassungssituation tritt auf, wenn das Modell zu viele Datensätze hat und eine Klassifizierung oder Vorhersage durchgeführt wird, bei der einige Prädikatoren das Rauschen anderer Klassen haben. Bei dieser Armatur soll das Modell eine unerwartet hohe Genauigkeit ergeben. Bei einer Überanpassung kann es vorkommen, dass das Modell die Variable aufgrund von Verwirrung in der Logik aufgrund zu vieler Bedingungen nicht klassifiziert. Die Rückwärtsentfernungstechnik verringert das Fremdmerkmal, um die Situation der Überanpassung zu umgehen.

2. Mängel

Nachteile der Rückwärtseliminierung sind wie folgt:

- Bei der Rückwärtseliminierungsmethode kann man nicht herausfinden, welcher Prädikator für die Zurückweisung eines anderen Prädikators verantwortlich ist, weil er bis zur Bedeutungslosigkeit reicht. Zum Beispiel, wenn Prädikator X eine Bedeutung hat, die gut genug war, um nach dem Hinzufügen des Y-Prädikators in einem Modell zu liegen. Die Bedeutung von X wird jedoch veraltet, wenn ein anderer Prädikator Z in das Modell aufgenommen wird. Der Rückwärtseliminierungsalgorithmus erkennt also keine Abhängigkeit zwischen zwei Prädiktoren, die bei der "Vorwärtsauswahltechnik" auftreten.

- Nach dem Verwerfen eines Features aus einem Modell durch einen Rückwärtseliminierungsalgorithmus kann dieses Feature nicht erneut ausgewählt werden. Kurz gesagt, die Rückwärtseliminierung bietet keinen flexiblen Ansatz zum Hinzufügen oder Entfernen von Merkmalen / Prädiktoren.

- Die Normen zur Auswahl des Signifikanzwerts (0, 06) im Modell sind unflexibel. Die Rückwärtseliminierung verfügt nicht über ein flexibles Verfahren, um nicht nur den unbedeutenden Wert auszuwählen, sondern auch nach Bedarf zu ändern, um die beste Anpassung unter einem geeigneten Datensatz zu erzielen.

Fazit

Das Verfahren der Rückwärtseliminierung wurde entwickelt, um die Leistung des Modells zu verbessern und seine Komplexität zu optimieren. Es wird lebhaft in mehreren Regressionen verwendet, in denen das Modell mit dem umfangreichen Datensatz umgeht. Dies ist ein einfacher und einfacher Ansatz im Vergleich zur Vorauswahl und Kreuzvalidierung, bei denen es zu einer Überlastung der Optimierung kommt. Die Rückwärtseliminierungstechnik initiiert die Eliminierung von Merkmalen mit höherem Signifikanzwert. Grundlegendes Ziel ist es, das Modell weniger komplex zu machen und Überanpassungssituationen zu vermeiden.

Empfohlene Artikel

Dies ist eine Anleitung zur Rückwärtseliminierung. Hier diskutieren wir, wie man die Rückwärtseliminierung zusammen mit den Vorzügen und Nachteilen anwendet. Sie können sich auch die folgenden Artikel ansehen, um mehr zu erfahren.

- Hyperparameter Maschinelles Lernen

- Clustering im maschinellen Lernen

- Java virtuelle Maschine

- Unüberwachtes maschinelles Lernen