Einführung in die eingeschränkte Boltzmann-Maschine

Die eingeschränkte Boltzmann-Maschine ist eine Methode, die durch Rekonstruktion unserer Eingaben automatisch Muster in Daten finden kann. Geoff Hinton ist der Begründer des Deep Learning. RBM ist ein oberflächliches zweischichtiges Netzwerk, in dem die erste die sichtbare und die nächste die verborgene Schicht ist. Jeder einzelne Knoten in der sichtbaren Ebene ist mit jedem einzelnen Knoten in der verborgenen Ebene verbunden. Eingeschränkte Boltzmann-Maschine gilt als eingeschränkt, da zwei Knoten derselben Schicht keine Verbindung bilden. Ein RBM ist das numerische Äquivalent eines Zweiwege-Übersetzers. Auf dem Vorwärtspfad empfängt ein RBM die Eingabe und konvertiert sie in eine Reihe von Zahlen, die die Eingabe codieren. Auf dem Rückweg nimmt es dies als Ergebnis und verarbeitet diesen Satz von Eingaben und übersetzt sie in umgekehrter Reihenfolge, um die zurückverfolgten Eingaben zu bilden. Ein hervorragend ausgebildetes Netzwerk kann diesen umgekehrten Übergang mit hoher Genauigkeit durchführen. In zwei Schritten spielen Gewicht und Werte eine sehr wichtige Rolle. Sie ermöglichen dem RBM, die Wechselbeziehungen zwischen den Eingaben zu dekodieren, und helfen dem RBM auch bei der Entscheidung, welche Eingabewerte für die Ermittlung der korrekten Ausgaben am wichtigsten sind.

Funktionieren der eingeschränkten Boltzmann-Maschine

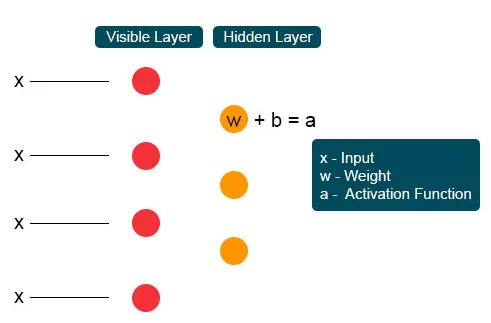

Jeder einzelne sichtbare Knoten erhält von einem Knoten im Datensatz einen Low-Level-Wert. Am ersten Knoten der unsichtbaren Schicht wird X durch ein Gewichtsprodukt gebildet und zu einer Vorspannung addiert. Das Ergebnis dieses Prozesses wird einer Aktivierung zugeführt, die die Leistung des gegebenen Eingangssignals oder des Ausgangs des Knotens erzeugt.

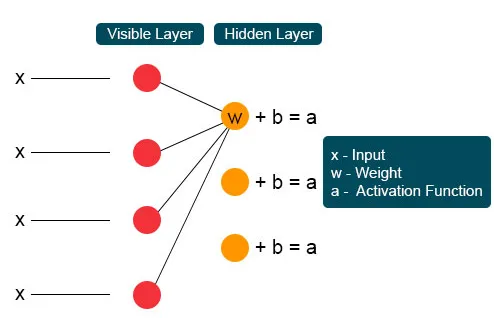

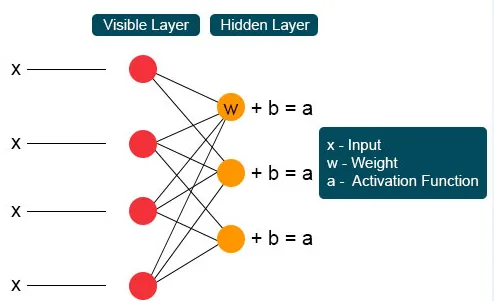

Im nächsten Prozess würden sich mehrere Eingaben an einem einzigen versteckten Knoten verbinden. Jedes X wird durch das individuelle Gewicht kombiniert, die Addition des Produkts wird zu Werten zusammengefasst und das Ergebnis wird erneut durch Aktivierung weitergeleitet, um die Ausgabe des Knotens zu erhalten. An jedem unsichtbaren Knoten wird jede Eingabe X mit einer individuellen Gewichtung W kombiniert. Die Eingabe X hat hier drei Gewichte, also zwölf zusammen. Das zwischen der Schicht gebildete Gewicht wird zu einem Array, in dem Zeilen für Eingabeknoten und Spalten für Ausgabeknoten genau sind.

Jeder unsichtbare Knoten erhält vier Antworten, multipliziert mit ihrem Gewicht. Die Addition dieses Effekts wird erneut zum Wert addiert. Dies wirkt als Katalysator für einen Aktivierungsprozess und das Ergebnis wird erneut dem Aktivierungsalgorithmus zugeführt, der für jede einzelne unsichtbare Eingabe jede einzelne Ausgabe erzeugt.

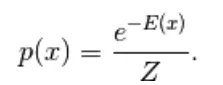

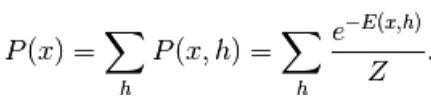

Das erste Modell, das hier abgeleitet wird, ist das energiebasierte Modell. Dieses Modell ordnet jeder Konfiguration der Variablen skalare Energie zu. Dieses Modell definiert die Wahrscheinlichkeitsverteilung über eine Energiefunktion wie folgt:

(1)

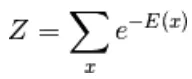

Hier ist Z der Normalisierungsfaktor. Dies ist die Partitionsfunktion in Bezug auf physische Systeme

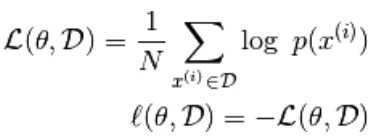

In dieser energiebasierten Funktion folgt eine logistische Regression, die im ersten Schritt die log- definiert. Wahrscheinlichkeit und die nächste definieren die Verlustfunktion als negative Wahrscheinlichkeit.

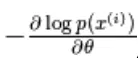

unter Verwendung des stochastischen Gradienten,  wo

wo  sind die Parameter,

sind die Parameter,

Das energiebasierte Modell mit einer versteckten Einheit wird als 'h' definiert.

Der beobachtete Teil wird als 'x' bezeichnet

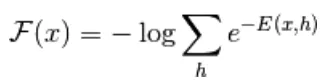

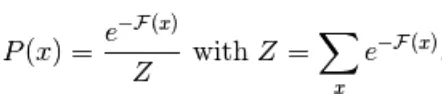

Aus Gleichung (1) ist die Gleichung der freien Energie F (x) wie folgt definiert

(2)

(3)

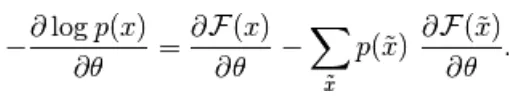

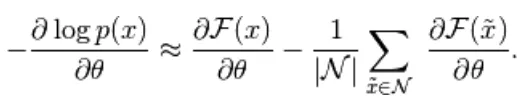

Der negative Gradient hat folgende Form:

(4)

Die obige Gleichung hat zwei Formen, die positive und die negative Form. Der Ausdruck positiv und negativ wird nicht durch Vorzeichen der Gleichungen dargestellt. Sie zeigen den Effekt der Wahrscheinlichkeitsdichte. Der erste Teil zeigt die Wahrscheinlichkeit der Reduzierung der entsprechenden freien Energie. Der zweite Teil zeigt, wie sich die Wahrscheinlichkeit von Stichproben reduziert. Dann wird der Gradient wie folgt bestimmt:

(5)

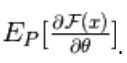

Hier ist N negative Teilchen. In diesem energiebasierten Modell ist es schwierig, den Gradienten analytisch zu identifizieren, da er die Berechnung von einschließt

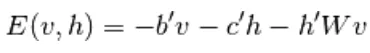

Daher haben wir in diesem EBM-Modell eine lineare Beobachtung, die die Daten nicht genau abbilden kann. Im nächsten Modell Restricted Boltzmann Machine soll die Hidden-Ebene daher eine hohe Genauigkeit aufweisen und Datenverluste verhindern. Die RBM-Energiefunktion ist definiert als

(6)

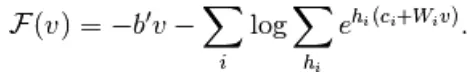

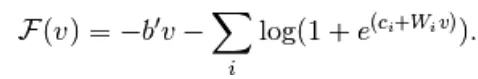

Hier ist W die Gewichtsverbindung zwischen sichtbaren und versteckten Schichten. b ist der Versatz der sichtbaren Ebene. c ist der Versatz der verborgenen Ebene. durch Umwandlung in freie Energie,

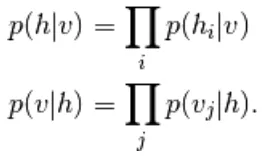

In RBM sind die Einheiten der sichtbaren und der verborgenen Ebene völlig unabhängig, was wie folgt geschrieben werden kann:

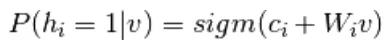

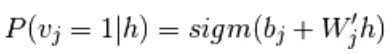

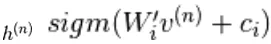

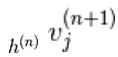

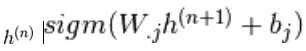

Aus Gleichung 6 und 2 geht eine probabilistische Version der Neuronenaktivierungsfunktion hervor.

(7)

(8)

Es wird weiter vereinfacht in

(9)

Gleichung 5 und 9 kombinieren,

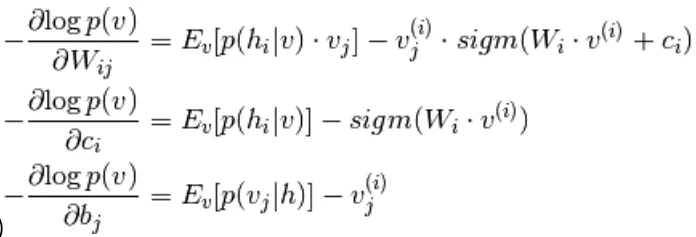

(10)

Probenahme in Boltzmann-Restricted-Maschine

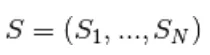

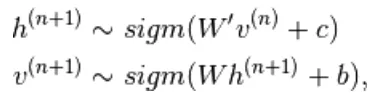

Gibbs-Stichprobe des Gelenks von N Zufallsvariablen  erfolgt durch eine Folge von N Abtast-Teilschritten des Formulars

erfolgt durch eine Folge von N Abtast-Teilschritten des Formulars  wo

wo

enthält  die anderen Zufallsvariablen in

die anderen Zufallsvariablen in  ohne.

ohne.

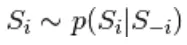

In RBM ist S eine Menge von sichtbaren und versteckten Einheiten. Die beiden Teile sind unabhängig voneinander und können Gibbs-Abtastungen durchführen oder blockieren. Hier führt die sichtbare Einheit eine Abtastung durch und gibt verborgenen Einheiten einen festen Wert, während verborgene Einheiten der sichtbaren Einheit durch Abtastung feste Werte bereitstellen

Hier,  wird von allen versteckten Einheiten gesetzt.

wird von allen versteckten Einheiten gesetzt.  Ein Beispiel

Ein Beispiel  wird zufällig ausgewählt, um 1 (gegen 0) mit Wahrscheinlichkeit zu sein,

wird zufällig ausgewählt, um 1 (gegen 0) mit Wahrscheinlichkeit zu sein,  und ähnlich,

und ähnlich,  wird zufällig mit einer Wahrscheinlichkeit von 1 (gegen 0) gewählt

wird zufällig mit einer Wahrscheinlichkeit von 1 (gegen 0) gewählt

Kontrastive Divergenz

Es wird als Katalysator verwendet, um den Probenahmeprozess zu beschleunigen

Da wir erwarten, dass es wahr ist, erwarten wir es  der Verteilungswert muss nahe an P liegen, damit er eine Konvergenz zur endgültigen Verteilung von P bildet

der Verteilungswert muss nahe an P liegen, damit er eine Konvergenz zur endgültigen Verteilung von P bildet

Die kontrastive Divergenz wartet jedoch nicht darauf, dass die Kette konvergiert. Das Sample wird erst nach Gibbs Prozess erhalten, daher setzen wir hier k = 1, wo es überraschend gut funktioniert.

Anhaltende kontrastive Divergenz

Dies ist eine weitere Methode zur Näherungsabtastung. Es ist ein beständiger Zustand für jede Probenahmemethode, mit der neue Proben durch einfaches Ändern der Parameter von K extrahiert werden.

Schichten der eingeschränkten Boltzmann-Maschine

Die eingeschränkte Boltzmann-Maschine hat zwei Ebenen, flache neuronale Netzwerke, die zusammen einen Block von Deep-Believe-Netzwerken bilden. Die erste Schicht ist die sichtbare Schicht und die andere Schicht ist die verborgene Schicht. Jede Einheit bezieht sich auf einen neuronenähnlichen Kreis, der als Knoten bezeichnet wird. Die Knoten der ausgeblendeten Ebene sind mit Knoten der sichtbaren Ebene verbunden. Zwei Knoten derselben Ebene sind jedoch nicht verbunden. Hier bezieht sich der Begriff Eingeschränkt auf keine Kommunikation innerhalb einer Schicht. Jeder Knoten verarbeitet die Eingabe und trifft die stochastische Entscheidung, ob die Eingabe gesendet werden soll oder nicht.

Beispiele

Die wichtige Rolle des RBM ist eine Wahrscheinlichkeitsverteilung. Sprachen sind in ihren Buchstaben und Lauten einzigartig. Die Wahrscheinlichkeitsverteilung des Buchstabens kann hoch oder niedrig sein. Im Englischen sind die Buchstaben T, E und A weit verbreitet. Aber auf Isländisch sind die allgemeinen Buchstaben A und N. Wir können nicht versuchen, Isländisch mit einem Gewicht zu rekonstruieren, das auf Englisch basiert. Es wird zu Abweichungen führen.

Das nächste Beispiel sind Bilder. Die Wahrscheinlichkeitsverteilung ihres Pixelwerts ist für jede Art von Bild unterschiedlich. Wir können davon ausgehen, dass es zwei Bilder gibt: Elephant und Dog für zwei Eingangsknoten. Der Vorwärtsdurchlauf von RBM erzeugt eine Frage wie: Soll ich einen starken Pixelknoten für einen Elefantenknoten oder einen Hundeknoten erzeugen? Dann wird Rückwärtsdurchlauf Fragen wie für Elefanten erzeugen, wie soll ich eine Verteilung von Pixeln erwarten? Dann werden sie mit einer gemeinsamen Wahrscheinlichkeit und Aktivierung durch Knoten ein Netzwerk mit gemeinsamen Vorkommen aufbauen, wie große Ohren, graue nichtlineare Röhren, Schlappohren, Falten sind der Elefant. Daher ist RBM der Prozess des tiefen Lernens und der Visualisierung. Sie bilden zwei Hauptverzerrungen und wirken auf ihren Aktivierungs- und Rekonstruktionssinn.

Vorteile der eingeschränkten Boltzmann-Maschine

- Die eingeschränkte Boltzmann-Maschine ist ein angewandter Algorithmus, der für Klassifizierung, Regression, Themenmodellierung, kollaboratives Filtern und Merkmalslernen verwendet wird.

- Die eingeschränkte Boltzmann-Maschine wird für die Bildgebung, die sparsame Bildrekonstruktion bei der Minenplanung und auch bei der Erkennung von Radarzielen verwendet

- RBM kann unausgeglichene Datenprobleme durch SMOTE-Verfahren lösen

- RBM finden fehlende Werte durch Gibbs Stichprobe, die angewendet wird, um die unbekannten Werte abzudecken

- RBM überwindet das Problem von verrauschten Etiketten durch nicht korrigierte Etikettendaten und deren Rekonstruktionsfehler

- Das Problem mit unstrukturierten Daten wird durch den Feature-Extraktor behoben, der die Rohdaten in versteckte Einheiten umwandelt.

Fazit

Deep Learning ist sehr mächtig, was die Kunst ist, komplexe Probleme zu lösen. Es ist immer noch ein Raum für Verbesserungen und eine komplexe Implementierung. Freie Variablen müssen sorgfältig konfiguriert werden. Die Ideen hinter dem neuronalen Netz waren früher schwierig, aber heute ist tiefes Lernen der Fuß von maschinellem Lernen und künstlicher Intelligenz. Daher gibt RBM einen Einblick in die riesigen Deep-Learning-Algorithmen. Es befasst sich mit der Grundeinheit der Komposition, die sich zu vielen populären Architekturen entwickelt und in vielen großen Industrien weit verbreitet ist.

Empfohlener Artikel

Dies war ein Leitfaden für die eingeschränkte Boltzmann-Maschine. Hier diskutieren wir seine Arbeitsweise, Probenahme, Vorteile und Schichten der eingeschränkten Boltzmann-Maschine. Sie können auch unsere anderen Artikelvorschläge durchgehen, um mehr zu erfahren. _

- Algorithmen für maschinelles Lernen

- Architektur des maschinellen Lernens

- Arten des maschinellen Lernens

- Werkzeuge für maschinelles Lernen

- Implementierung neuronaler Netze