Was ist schwein

Pig ist eine Open Source-Engine, die Teil der Hadoop-Ökosystemtechnologien ist. Pig kann hervorragend mit Daten arbeiten, die über herkömmliche Datenbanken oder Data Warehouses hinausgehen. Dies kann gut mit fehlenden, unvollständigen oder inkonsistenten Daten umgehen, die kein Schema haben. Das Schwein hat eine eigene Sprache zum Ausdrücken von Datenmanipulationen, nämlich das Schweinelatein.

Pig verstehen

Pig ist eine Technologie, mit der Sie umfangreiche, aber äußerst detaillierte Skripts schreiben können, mit denen Sie mit Daten arbeiten können, bei denen das Schema entweder unbekannt oder inkonsistent ist. Pig ist eine Open Source-Technologie, die auf Hadoop läuft und Teil des äußerst lebendigen und beliebten Hadoop-Ökosystems ist.

Pig funktioniert gut mit unstrukturierten und unvollständigen Daten, sodass Sie nicht für alles das herkömmliche Layout von Regeln und Spalten benötigen.

Es ist gut definiert und kann direkt mit Dateien in HDFS (Hadoop Distributed File System) arbeiten.

Das Schwein ist die Technologie Ihrer Wahl, wenn Sie Daten von der Quelle in ein Data Warehouse übertragen möchten.

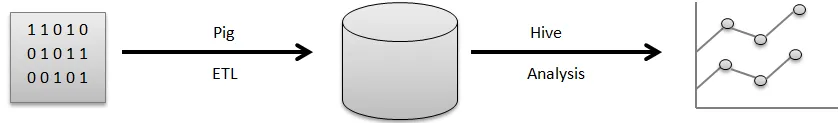

Ein Beispiel ist eine visuelle Pipeline, in der dargestellt wird, wie Daten normalerweise fließen, bevor Sie sie zum Generieren der Diagramme verwenden können, die Sie zum Treffen von Geschäftsentscheidungen verwenden.

Die Rohdaten stammen aus verschiedenen Quellen, z. B. Sensoren, Mobiltelefonen usw. Anschließend führen Sie mit Pig eine ETL-Operation durch. ETL steht für Extrahieren, Transformieren und Laden. Sobald diese Vorgänge ausgeführt wurden, werden die bereinigten Daten in einer anderen Datenbank gespeichert. Ein Beispiel für eine solche Datenbank wäre HDFS, ein Teil von Hadoop. Hive ist ein Data Warehouse, das auf einem solchen Dateisystem ausgeführt wird. Mit Hive können Sie Analysen durchführen, Berichte erstellen und Erkenntnisse gewinnen.

ETL ist ein sehr wichtiger Schritt in der Datenverarbeitung, um die Rohdaten zu bereinigen und in der richtigen Form in einer Datenbank zu speichern. Extrakt bezieht sich auf den Vorgang des Abrufs unstrukturierter, inkonsistenter Daten mit fehlendem Feld und fehlenden Werten aus der Originalquelle. Transform steht für die Reihe von Operationen, die Sie auf die Daten anwenden würden, um sie zu bereinigen oder abzurufen.

Vorberechnung nützlicher aggregierter Informationen, Verarbeitung von Feldern, um sie einem bestimmten Format anzupassen. All dies ist Teil der Datenbereinigung der Transformationsfelder.

Schließlich führt Pig die Ladeoperation aus, bei der diese bereinigten Daten in einer Datenbank gespeichert werden, in der sie weiter analysiert werden können. Ein Beispiel für eine Standardoperation, die Pig ausführt, ist das Bereinigen von Protokolldateien.

Erläutern Sie die Architektur von Schweinen

Es gibt zahlreiche Schweineteile in der Architektur, bevorzugen:

- Parser : Parser befasst sich mit Pig-Skripten sowie prüft die Syntax des Skripts, prüft die Typüberprüfung und verschiedene verschiedene Überprüfungen. Außerdem kann das Ergebnis eine DAG (Directed Acyclic Graph) sein, die normalerweise die lateinischen Behauptungen von Pig zusammen mit logischen Operatoren kennzeichnet.

Außerdem werden die logischen Operatoren mit dem Skript wie die Knoten sowie die Datenflüsse seit den Kanten durch die DAG angezeigt.

- Optimierer: Später wird der logische Plan (DAG) in der Regel gegenüber dem logischen Optimierer überschritten. Es führt die logischen Optimierungen zusätzlich einschließlich Projektion durch und fördert Low

- Compiler: Der Compiler kompiliert auch diesen erweiterten logischen Plan in einer Gruppe von MapReduce-Funktionen.

- Ausführungs-Engine: Letztendlich werden alle MapReduce-Arbeiten in einer sortierten Reihenfolge auf Hadoop veröffentlicht. Letztendlich führt dies zu den erforderlichen Ergebnissen, obwohl diese MapReduce-Arbeiten mit Hadoop ausgeführt werden.

- MapReduce: MapReduce wurde ursprünglich in Google entwickelt, um Webseiten so zu verarbeiten, dass die Google-Suche unterstützt wird. MapReduce verteilt die Datenverarbeitung auf mehrere Computer im Cluster. MapReduce nutzt die inhärente Parallelität bei der Datenverarbeitung. Moderne Systeme wie Sensoren oder sogar Facebook-Statusaktualisierungen generieren Millionen von Aufzeichnungen von Rohdaten.

Eine Aktivität mit dieser Stufe kann in zwei Phasen vorbereitet werden:

- Karte

- Reduzieren

Sie entscheiden, welche Logik Sie in diesen Phasen implementieren möchten, um Ihre Daten zu verarbeiten.

- HDFS (Hadoop Distributed File System): Hadoop ermöglicht eine Explosion der Datenspeicherung und -analyse in unbegrenzter Größe. Entwickler verwenden eine Anwendung wie Pig, Hive, HBase und Spark, um Daten von HDFS abzurufen.

Eigenschaften

Apache Pig bietet folgende Funktionen:

- Die Einfachheit der Programmierung: Pig Latin ist vergleichbar mit SQL und daher ist es für Entwickler recht einfach, ein Pig-Skript zu erstellen. Wenn Sie ein Verständnis der SQL-Sprache haben, ist das Erlernen der lateinischen Sprache von Pig unglaublich einfach, da es genau wie die SQL-Sprache ist.

- Umfangreiche Operatorsätze: Pig enthält eine Vielzahl von umfangreichen Operatorsätzen, mit denen Prozeduren wie Join, Filer, Sort und vieles mehr ausgeführt werden können.

- Optimierungsmöglichkeiten: Die Leistung der Aufgabe in Apache Pig kann sofort durch die Aufgabe selbst verbessert werden. Daher müssen sich die Entwickler nur auf die Semantik dieser Sprache konzentrieren.

- Erweiterbarkeit: Mithilfe zugänglicher Operatoren können Benutzer einfach ihre Funktionen zum Lesen, Verarbeiten und Schreiben von Daten entwickeln.

- Benutzerdefinierte Funktionen (User Define Functions, UDFs): Mithilfe des von Pig für die Erstellung von UDFs bereitgestellten Dienstes konnten wir benutzerdefinierte Funktionen für die Anzahl der Entwicklungssprachen einschließlich Java erstellen sowie alle von ihnen in Pig-Skripten aufrufen oder einbetten.

Wofür ist Schwein nützlich?

Es wird sowohl zur Prüfung als auch zur Wahrnehmung von Verantwortlichkeiten einschließlich der Ad-hoc-Bearbeitung verwendet. Apache Pig kann verwendet werden für:

Die Analyse mit riesigen Rohdatensammlungen bevorzugt die Datenverarbeitung, um Such-Websites zu erhalten. Wie Yahoo profitiert auch Apache Pig von Google, um über Google und Yahoo-Suchmaschinen gesammelte Daten auszuwerten. Bewältigen Sie große Datensammlungen wie Webdatensätze, streamen Sie Online-Informationen usw. Selbst die Statusaktualisierungen von Facebook generieren Millionen von Aufzeichnungen von Rohdaten.

Wie hilft Ihnen diese Technologie, in Ihrer Karriere zu wachsen?

Viele Organisationen implementieren Apache Pig unglaublich schnell. Dies bedeutet, dass die Berufe in der Schweine- und Schweineberufsbildung täglich zunehmen. Die Entwicklung von Apache Hadoop hat in den letzten Jahren enorme Fortschritte gemacht. Hadoop-Elemente wie Hive, Pig, HDFS, HBase, MapReduce usw.

Obwohl Hadoop-Angebote zu diesem Zeitpunkt in das zweite Jahrzehnt eingetreten sind, sind sie in den letzten drei bis vier Jahren in Anerkennung explodiert. Eine große Anzahl von Softwareunternehmen wendet unglaublich häufig Hadoop-Cluster an. Dies kann definitiv der beste Teil von Big Data sein. Die Zielexperten konnten Erfahrungen mit dieser hervorragenden Technologie sammeln.

Fazit

Apache Pig Expertise ist auf dem Markt sehr gefragt und kann weiter ausgebaut werden. Durch einfaches Verständnis der Konzepte und Erfahrung mit den besten Fähigkeiten von Apache Pig in Hadoop können die Experten ihren Beruf als Apache Pig perfekt ausüben.

Empfohlener Artikel

Dies war ein Leitfaden für What is Pig? Hier haben wir die Konzepte, Definitionen und Architekturen mit den Funktionen von Pig besprochen. Sie können auch unsere anderen Artikelvorschläge durchgehen, um mehr zu erfahren -

- So installieren Sie Apache

- Fragen in Vorstellungsgesprächen bei Apache PIG

- Was sind ASP.Net-Webdienste?

- Was ist Blockchain-Technologie?