Einführung in den Entscheidungsbaumalgorithmus

Wenn wir ein Problem zu lösen haben, das entweder ein Klassifizierungs- oder ein Regressionsproblem ist, ist der Entscheidungsbaum-Algorithmus einer der beliebtesten Algorithmen, die zum Erstellen der Klassifizierungs- und Regressionsmodelle verwendet werden. Sie fallen unter die Kategorie des überwachten Lernens, dh Daten, die gekennzeichnet sind.

Was ist der Entscheidungsbaum-Algorithmus?

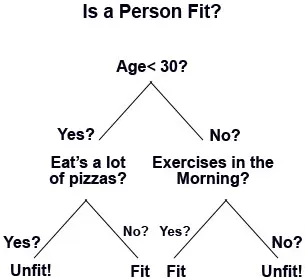

Der Entscheidungsbaumalgorithmus ist ein überwachter Algorithmus für maschinelles Lernen, bei dem Daten in jeder Zeile auf der Grundlage bestimmter Regeln fortlaufend aufgeteilt werden, bis das endgültige Ergebnis generiert wird. Nehmen wir ein Beispiel, Sie eröffnen ein Einkaufszentrum und möchten natürlich, dass es mit der Zeit im Geschäft wächst. In diesem Fall benötigen Sie Stammkunden und neue Kunden in Ihrem Einkaufszentrum. Dazu bereiten Sie verschiedene Geschäfts- und Marketingstrategien vor, z. B. das Versenden von E-Mails an potenzielle Kunden. Angebote und Deals erstellen, neue Kunden ansprechen usw. Aber woher wissen wir, wer die potenziellen Kunden sind? Mit anderen Worten, wie klassifizieren wir die Kategorie der Kunden? Einige Kunden besuchen uns einmal in der Woche, andere möchten ein- oder zweimal im Monat oder einige besuchen uns in einem Vierteljahr. Entscheidungsbäume sind ein solcher Klassifizierungsalgorithmus, der die Ergebnisse in Gruppen klassifiziert, bis keine Ähnlichkeit mehr besteht.

Auf diese Weise wird der Entscheidungsbaum in einem Baumstrukturformat abgespeichert. Die Hauptkomponenten eines Entscheidungsbaums sind:

- Entscheidungsknoten: Hier werden die Daten aufgeteilt oder sagen, es ist ein Ort für das Attribut.

- Entscheidungslink, der eine Regel darstellt.

- Entscheidungsblätter, die die Endergebnisse sind.

Arbeiten eines Entscheidungsbaumalgorithmus

Es gibt viele Schritte, die bei der Bearbeitung eines Entscheidungsbaums erforderlich sind:

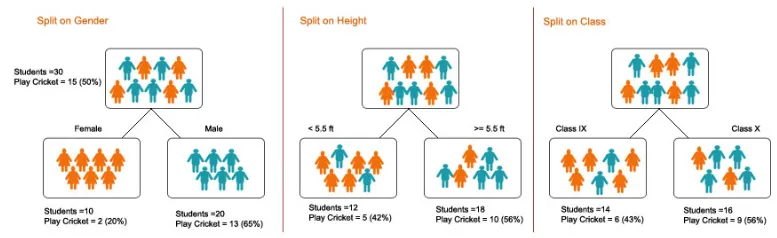

1. Aufteilen - Hierbei handelt es sich um das Aufteilen von Daten in Teilmengen. Die Aufteilung kann nach verschiedenen Faktoren erfolgen, z. B. nach Geschlecht, Größe oder Klasse.

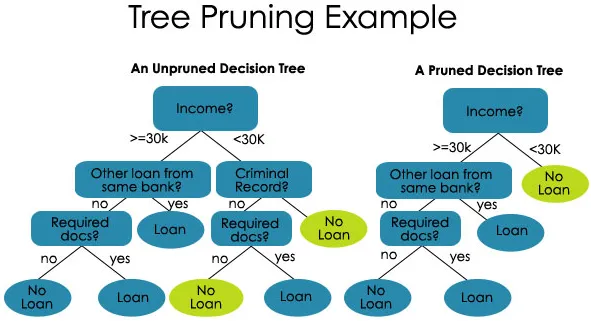

2. Beschneiden - Hierbei werden die Zweige des Entscheidungsbaums gekürzt, wodurch die Baumtiefe begrenzt wird

Es gibt auch zwei Arten des Beschneidens:

- Pre-Pruning - Hier hören wir auf, den Baum zu wachsen, wenn wir keine statistisch signifikante Assoziation zwischen den Attributen und der Klasse an einem bestimmten Knoten finden.

- Nach dem Beschneiden - Um nach dem Beschneiden zu arbeiten, müssen wir die Leistung des Test-Set-Modells validieren und dann die Äste abschneiden, die das Ergebnis von Überanpassungsgeräuschen des Trainings-Sets sind.

3. Baumauswahl - Der dritte Schritt besteht darin, den kleinsten Baum zu finden, der zu den Daten passt.

Beispiele und Illustration zur Erstellung eines Entscheidungsbaums

Nun, da wir die Prinzipien eines Entscheidungsbaums gelernt haben. Lassen Sie uns dies anhand eines Beispiels verstehen und veranschaulichen.

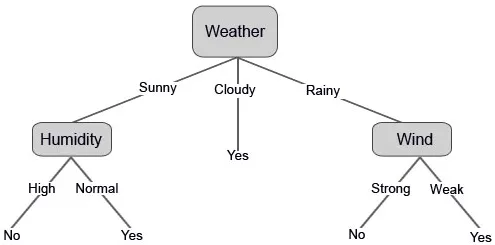

Angenommen, Sie möchten an einem bestimmten Tag (z. B. Samstag) Cricket spielen. Was sind die Faktoren, die entscheiden, ob das Spiel stattfinden wird oder nicht?

Klar, der Hauptfaktor ist das Klima, kein anderer Faktor hat eine so hohe Wahrscheinlichkeit für die Spielunterbrechung wie das Klima.

Wir haben die Daten der letzten 10 Tage gesammelt, die unten dargestellt sind:

| Tag | Wetter | Temperatur | Feuchtigkeit | Wind | Abspielen? |

| 1 | Wolkig | Heiß | Hoch | Schwach | Ja |

| 2 | Sonnig | Heiß | Hoch | Schwach | Nein |

| 3 | Sonnig | Mild | Normal | Stark | Ja |

| 4 | Regnerisch | Mild | Hoch | Stark | Nein |

| 5 | Wolkig | Mild | Hoch | Stark | Ja |

| 6 | Regnerisch | Cool | Normal | Stark | Nein |

| 7 | Regnerisch | Mild | Hoch | Schwach | Ja |

| 8 | Sonnig | Heiß | Hoch | Stark | Nein |

| 9 | Wolkig | Heiß | Normal | Schwach | Ja |

| 10 | Regnerisch | Mild | Hoch | Stark | Nein |

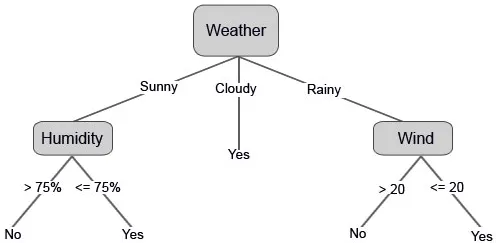

Lassen Sie uns nun unseren Entscheidungsbaum auf der Grundlage der uns vorliegenden Daten erstellen. Wir haben den Entscheidungsbaum in zwei Ebenen unterteilt, die erste basiert auf dem Attribut "Wetter" und die zweite Zeile basiert auf "Luftfeuchtigkeit" und "Wind". Die folgenden Bilder zeigen einen gelernten Entscheidungsbaum.

Wir können auch einige Schwellenwerte festlegen, wenn die Merkmale kontinuierlich sind.

Was ist Entropie im Entscheidungsbaumalgorithmus?

Mit einfachen Worten, Entropie ist das Maß dafür, wie ungeordnet Ihre Daten sind. Während Sie diesen Begriff vielleicht in Ihrem Mathematik- oder Physikunterricht gehört haben, ist er hier auch so.

Der Grund, warum Entropie im Entscheidungsbaum verwendet wird, liegt darin, dass das Endziel im Entscheidungsbaum darin besteht, ähnliche Datengruppen in ähnliche Klassen zu gruppieren, dh die Daten zu ordnen.

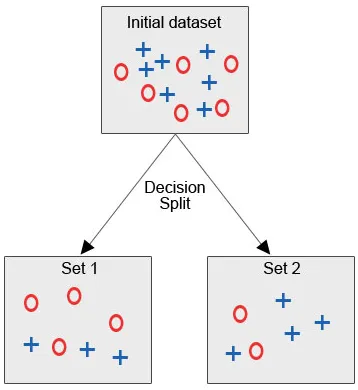

Sehen wir uns das folgende Bild an, in dem wir den anfänglichen Datensatz haben und den Entscheidungsbaumalgorithmus anwenden müssen, um die ähnlichen Datenpunkte in einer Kategorie zusammenzufassen.

Wie wir deutlich sehen können, fallen nach der Aufteilung der Entscheidung die meisten roten Kreise unter eine Klasse, während die meisten blauen Kreuze unter eine andere Klasse fallen. Daher wurde beschlossen, die Attribute zu klassifizieren, die auf verschiedenen Faktoren beruhen könnten.

Lassen Sie uns jetzt versuchen, hier etwas zu rechnen:

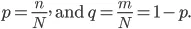

Angenommen, wir haben "N" Mengen des Artikels und diese Artikel fallen in zwei Kategorien. Um nun die Daten auf der Grundlage von Beschriftungen zu gruppieren, führen wir das Verhältnis ein:

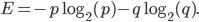

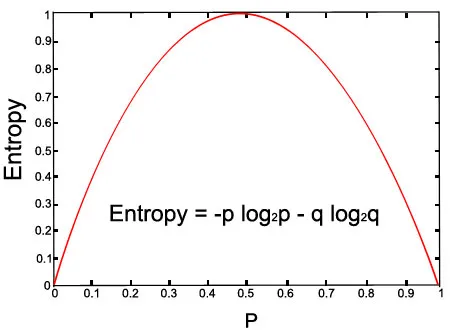

Die Entropie unserer Menge ergibt sich aus der folgenden Gleichung:

Schauen wir uns den Graphen für die gegebene Gleichung an:

Über dem Bild (mit p = 0, 5 und q = 0, 5)

Vorteile

1. Ein Entscheidungsbaum ist einfach zu verstehen und sobald er einmal verstanden ist, können wir ihn konstruieren.

2. Wir können einen Entscheidungsbaum sowohl für numerische als auch für kategoriale Daten implementieren.

3. Decision Tree hat sich als robustes Modell mit vielversprechenden Ergebnissen erwiesen.

4. Sie sind auch bei großen Datenmengen zeiteffizient.

5. Es erfordert weniger Aufwand für das Training der Daten.

Nachteile

1. Instabilität - Nur wenn die Informationen präzise und genau sind, liefert der Entscheidungsbaum vielversprechende Ergebnisse. Auch wenn sich die Eingabedaten geringfügig ändern, kann dies zu großen Änderungen im Baum führen.

2. Komplexität - Wenn der Datenbestand viele Spalten und Zeilen enthält, ist es eine sehr komplexe Aufgabe, einen Entscheidungsbaum mit vielen Zweigen zu entwerfen.

3. Kosten - Manchmal bleiben Kosten auch ein Hauptfaktor, denn wenn ein komplexer Entscheidungsbaum erstellt werden soll, sind fortgeschrittene Kenntnisse in quantitativer und statistischer Analyse erforderlich.

Fazit

In diesem Artikel lernten wir den Entscheidungsbaum-Algorithmus und wie man einen konstruiert. Wir sahen auch die große Rolle, die Entropy im Entscheidungsbaum-Algorithmus spielt, und sahen schließlich die Vor- und Nachteile des Entscheidungsbaums.

Empfohlene Artikel

Dies war ein Leitfaden für den Entscheidungsbaum-Algorithmus. Hier haben wir die Rolle von Entropie, Funktion, Vor- und Nachteilen besprochen. Sie können auch unsere anderen Artikelvorschläge durchgehen, um mehr zu erfahren -

- Wichtige Data Mining-Methoden

- Was ist eine Webanwendung?

- Leitfaden zu Was ist Data Science?

- Fragen in Vorstellungsgesprächen für Data Analyst

- Anwendung des Entscheidungsbaums im Data Mining